L'ONU alerte sur les deepfakes audio et la fraude organisée

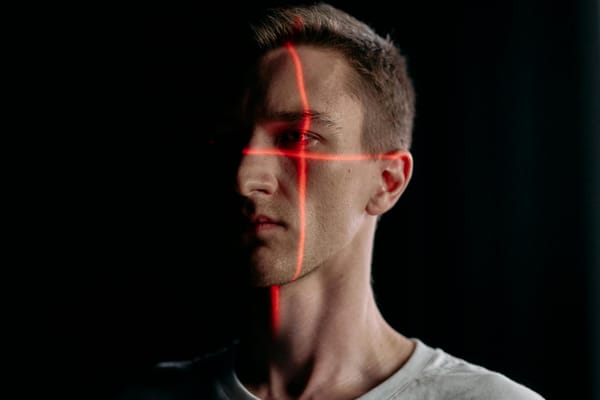

Les Nations unies alertent sur une évolution majeure : les technologies de deepfakes et de clonage vocal sont désormais utilisées à grande échelle par des réseaux criminels structurés. L’intelligence artificielle, initialement conçue comme un levier d’innovation, est aujourd’hui intégrée dans des systèmes de fraude industrialisés, capables d’opérer à l’échelle mondiale.

Ces organisations exploitent notamment la voix comme vecteur d’attaque. Grâce aux progrès récents, il est possible d’imiter de manière crédible un dirigeant, un collaborateur ou un proche, rendant les escroqueries plus efficaces et plus difficiles à détecter. Cette capacité s’inscrit dans une logique de “cybercriminalité en tant que service”, où des outils de fraude sont accessibles et mutualisés entre acteurs malveillants.

L’enjeu ne se limite plus à la détection.

Comme le souligne implicitement l’alerte des Nations unies, la généralisation de ces pratiques pose une question plus profonde : comment établir la confiance lorsque les signaux humains eux-mêmes peuvent être falsifiés ?

Dans ce contexte, la voix — longtemps perçue comme un élément fiable d’identification — perd sa valeur de référence. En cas de fraude, il devient non seulement difficile de détecter la manipulation, mais aussi de démontrer qu’elle a eu lieu.

Cette fragilisation de la preuve constitue un point de bascule.

Jusqu’à présent, les réponses se sont principalement concentrées sur l’analyse a posteriori : détecter, expertiser, comparer. Mais face à l’industrialisation des deepfakes, cette approche montre ses limites.

Une autre logique émerge progressivement : celle de la certification en amont.

Plutôt que de tenter de prouver après coup, il s’agit de disposer d’éléments vérifiables dès l’origine.

C’est dans ce cadre que s’inscrivent des initiatives comme VoxProof, qui explorent la possibilité de certifier une voix via une empreinte sécurisée et horodatée, afin de permettre, en cas de doute, une vérification fondée sur un référentiel préalable.

Sans prétendre répondre à l’ensemble des enjeux soulevés par les Nations unies, ce type d’approche illustre une évolution plus large :

👉 le passage d’une logique de détection à une logique de preuve.

À mesure que les deepfakes se généralisent, la capacité à établir l’authenticité d’un signal — et non plus seulement à suspecter sa falsification — pourrait devenir un élément clé des stratégies de sécurité.

Conclusion

L’alerte des Nations unies met en lumière une transformation profonde : la fraude ne repose plus uniquement sur la tromperie humaine, mais sur des infrastructures technologiques organisées.

Dans ce nouvel environnement, la question n’est plus seulement de reconnaître une voix.

👉 Elle devient celle de pouvoir en démontrer l’authenticité.